我感到害怕。很害怕。

由人工智能 (AI) 难以想象的强大计算能力实现的互联网范围内的监视和审查已经到来。

这不是未来的反乌托邦。现在正在发生。

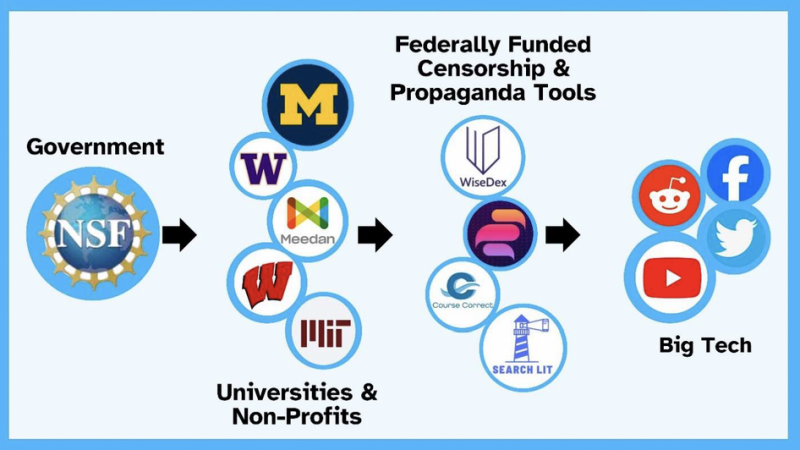

政府机构正在与大学和非营利组织合作,使用人工智能工具来监视和审查互联网上的内容。

这不是政治或党派之争。这与任何特定的意见或想法无关。

正在发生的事情是,政府可以使用一个强大到足以监视互联网上所说和所做的一切(或其中大部分)的工具来随时监视我们所有人。而且,基于这种监控,政府——以及与政府合作的任何组织或公司——可以使用相同的工具来压制、压制和关闭任何它不喜欢的言论。

但这还不是全部。使用相同的工具,政府及其公私“非政府”合作伙伴(例如:世界卫生组织或孟山都)也可以关闭任何与互联网相关的活动。银行、购买、销售、教学、学习、娱乐、相互联系——如果政府控制的人工智能不喜欢你(或你的孩子!)在推文或电子邮件中所说的内容,它可以关闭所有这些你。

是的,我们已经在非常本地化和政治化的规模上看到了这一点,例如, 加拿大卡车司机.

但如果我们认为这种类型的活动不可能或不会在全国范围内(甚至更可怕的全球范围)发生,那么我们需要立即醒来并意识到它正在发生,而且可能无法阻止。

新文件显示政府资助的人工智能旨在进行在线审查

美国众议院联邦政府武器化特别小组委员会 该委员会成立于 2023 年 XNUMX 月,“旨在调查行政部门机构收集、分析、传播和使用美国公民信息的相关事宜,包括此类行为是否非法、违宪或其他不道德行为。”

不幸的是,该委员会的工作被认为主要是政治性的,即使是其成员也是如此:保守派立法者正在调查他们认为倾向自由派的政府机构压制保守派声音的行为。

然而,在调查中,该委员会发现了一些与政府试图审查美国公民言论有关的令人震惊的文件。

这些文件对全社会具有至关重要且可怕的影响。

在小组委员会的中期报告中, 日期为 5 年 2024 月 XNUMX 日文件显示,学术和非营利组织正在向政府机构推销一项计划,利用人工智能“错误信息服务”来审查互联网平台上的内容。

具体来说,密歇根大学正在向美国国家科学基金会(NSF)解释说,由 NSF 资助的人工智能工具可用于帮助社交媒体平台执行审查活动,而无需实际就应该审查的内容做出决定。

以下是小组委员会的报告中对这种关系的形象化描述:

以下是小组委员会报告中提出的具体引述。它来自“密歇根大学向美国国家科学基金会 (NSF) 首次推介其由 NSF 资助、人工智能驱动的 WiseDex 工具的演讲者笔记。”这些注释已提交给委员会。

我们的错误信息服务可以帮助平台上的政策制定者……通过将审查制度的困难责任具体化,将困难判断的责任推给公司外部的人。

这在很多层面上都是一个非凡的声明:

- 它明确地将“错误信息服务”与审查制度等同起来。

这是一个至关重要的等式,因为世界各国政府都在假装打击有害的错误信息,而事实上他们却在打击有害的错误信息。 通过大规模审查法案。 该 世界经济论坛宣布 “错误信息和虚假信息”是未来两年“最严重的全球风险”,这大概意味着他们最大的努力将集中在审查制度上。

当政府承包商明确表示其正在销售帮助在线平台“外部化审查制度”的“错误信息服务”时,这两个术语被认为是可以互换的。

- 它将审查制度称为“责任”。

换句话说,它假设平台应该做的部分工作是审查。不保护儿童免受性掠夺者的侵害,也不保护无辜公民免受错误信息的侵害——只是简单明了、纯粹的审查制度。

- 它指出,人工智能的作用是将审查责任“外化”。

科技平台不想做出审查决定。政府希望做出这些决定,但不想被视为审查。人工智能工具允许平台“外部化”审查决定,并允许政府隐藏其审查活动。

所有这一切都应该结束这样一种幻想:世界各国政府所谓的“打击错误信息和仇恨言论”并不是直接的审查制度。

当人工智能审查制度全面实施时会发生什么?

知道政府已经在为人工智能审查工具付费,我们必须认真思考这意味着什么。

无人力限制: 正如小组委员会的报告指出的那样,到目前为止,政府在线审查制度的局限性涉及大量人员浏览无休止的文件并做出审查决定。有了人工智能,几乎不需要任何人类参与,并且可以监控的数据量可以与任何人在特定平台上所说的一切一样庞大。对于单个人脑来说,如此大量的数据是无法理解的。

没有人负责: 人工智能审查最可怕的方面之一是,当人工智能进行审查时,没有任何人或组织——无论是政府、平台还是大学/非营利组织——真正负责审查。最初,人类向人工智能工具提供指令,告知要审查哪些类别或类型的语言,但随后机器会自行根据具体情况做出决定。

申诉无权追索: 一旦人工智能通过一组审查指令被释放,它将清除无数的在线数据点并实施审查行动。如果你想对抗人工智能的审查行动,你就必须与机器交谈。也许这些平台会雇用人类来响应诉求。但是,当他们拥有可以自动执行这些响应的人工智能时,他们为什么要这样做呢?

对青少年没有保护: 政府审查机构提出的主张之一是,我们需要保护我们的孩子免受有害在线信息的侵害,例如使他们厌食、鼓励他们自杀、将他们变成伊斯兰国恐怖分子等的内容。也来自性剥削。这些都是值得关注的严重问题。但它们对大量年轻人来说并不像人工智能审查那么危险。

人工智能审查制度带来的危险适用于所有花大量时间上网的年轻人,因为这意味着他们的在线活动和语言可以被监控并用来对付他们——也许不是现在,但每当政府决定追捕特定类型的人时的语言或行为。对于更多的儿童来说,这比任何特定内容造成的危险要大得多,因为它涵盖了他们在网上进行的所有活动,几乎涉及他们生活的各个方面。

这里有一个例子来说明这种危险:假设您的孩子在网上玩很多互动视频游戏。假设他恰好喜欢中国公司设计的游戏。也许他也看别人玩这些游戏,并参加有关这些游戏的聊天和讨论组,其中也有很多中国公民参与。

政府可能会在下个月或明年决定,任何大量参与中国设计的视频游戏的人都会对民主构成威胁。这可能会导致您儿子的社交媒体帐户被关闭或无法使用金融工具,例如大学贷款。它还可能涉及在就业或约会网站上将他标记为危险或不受欢迎的人。这可能意味着他被拒绝发放护照或被列入观察名单。

你十几岁的孩子的生活变得更加困难。比他接触 ISIS 招募视频或美化自杀的 TikTok 帖子要困难得多。而且这种情况发生的规模比 审查员使用的性剥削 作为使在线政府审查制度正常化的特洛伊木马。

可货币化的审查服务:政府拥有的人工智能工具理论上可以在政府许可的情况下被非政府实体使用,并得到想要“外化”审查“责任”的平台的支持。因此,虽然政府可能会使用人工智能来监控和压制(举例来说)反战情绪,但公司可以使用人工智能来监控和压制(举例来说)反快餐情绪。政府可以通过向第三方出售人工智能工具的服务赚很多钱。可以想象,这些平台也可能会要求降价。因此,人工智能审查工具可能有利于政府、技术平台和私营企业。这些激励措施是如此强大,几乎无法想象它们不会被利用。

我们可以扭转路线吗?

我不知道有多少政府机构、有多少平台在使用AI审查工具。我不知道他们能多快扩大规模。

我不知道我们可以使用什么工具——除了提高认识、试图游说政客和提起诉讼以防止政府审查和规范人工智能工具在互联网上的使用。

如果有人有任何其他想法,现在就是实施它们的时候了。

发表于 知识共享署名4.0国际许可

如需转载,请将规范链接设置回原始链接 褐石研究所 文章和作者。